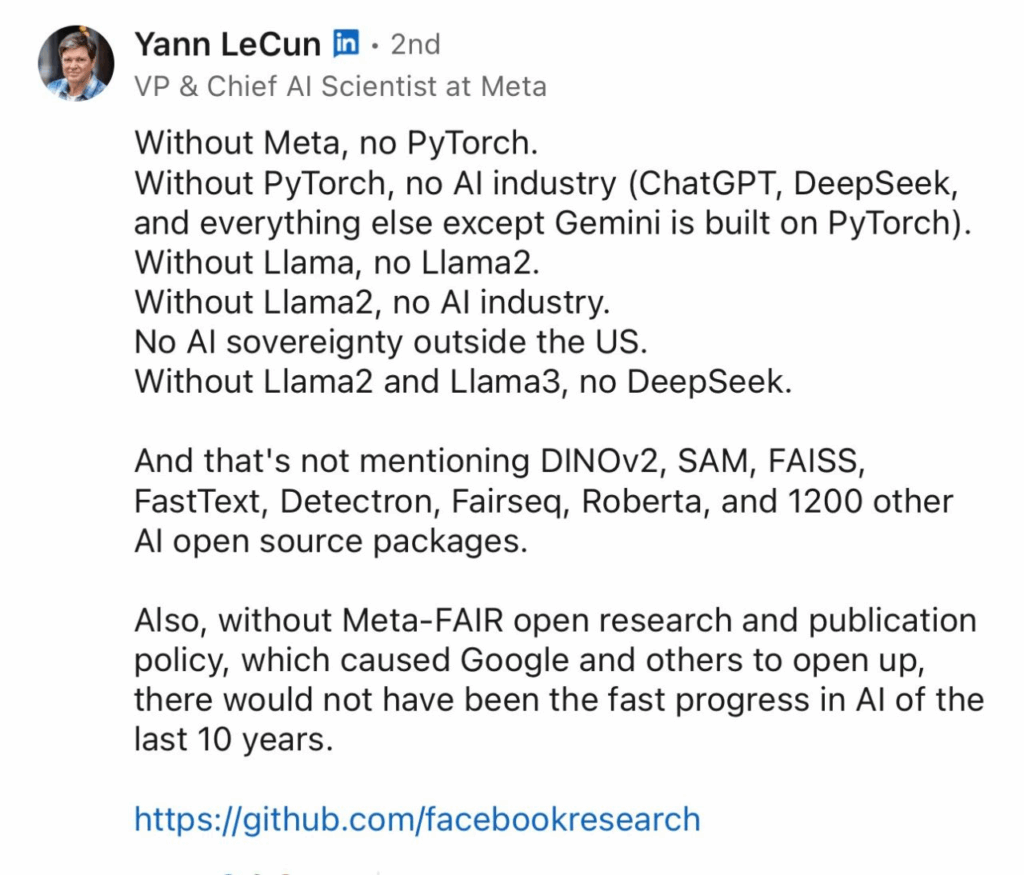

È sabato e desidero concedermi un momento di riflessione. C’è un paradosso elegante, quasi ironico, nel vedere Yann LeCun, Chief AI Scientist di Meta, lanciare la sua verità come un martello di Thor nel silenzio autoreferenziale della Silicon Valley: “Senza Meta, molta dell’AI moderna non esisterebbe.” E mentre il pubblico digita “OpenAI” nella barra di ricerca con la stessa naturalezza con cui un tempo si scriveva “Google”, c’è chi, nell’ombra, ha forgiato il ferro dell’open source per anni, senza mai ricevere il riconoscimento adeguato.

La questione, al di là delle polemiche e degli ego, è brutalmente evidente: senza PyTorch, oggi non avremmo neppure la metà della cultura di machine learning che inonda GitHub e arXiv. Quel framework flessibile, nato in un laboratorio di Meta (o meglio, Facebook AI Research, per coloro che si ricordano), costituisce l’asse fondamentale su cui poggiano DeepSeek, Mistral, LLaMA e un’intera galassia di modelli che si spacciano per “open”, “free” o “alternativi”.

Ma oggi il mondo applaude OpenAI e guarda ad Anthropic come se fossero gli unici creatori del nuovo sapere computazionale. È il classico fenomeno del brand overshadowing, una forma di miopia culturale in cui chi costruisce le fondamenta viene dimenticato non appena il palazzo brilla sotto i riflettori.

LeCun non è un predicatore del futuro: è un ingegnere del presente. Il suo tono, a metà strada tra la rivendicazione e la profezia, evidenzia una verità imbarazzante. Meta ha contribuito con oltre 1200 pacchetti open source (chi scrive codice lo sa bene); ha creato strumenti che sono diventati lingua franca per l’AI moderna: DINOv2, Segment Anything Model (SAM), RoBERTa, nomi che probabilmente non faranno trending su X, ma che nei laboratori contano più di un’intervista di Altman da Lex Fridman.

Curioso, però, che in un’epoca di closed weights, licenze pseudo-open e repository strategicamente “incompleti”, proprio Meta — il colosso accusato di violare la privacy globale — si erga a paladino dell’apertura radicale. È come se ExxonMobil lanciasse una startup per il clima. Ma è tutto vero. E profondamente strategico.

Perché l’apertura non è solo una virtù morale. È un’arma geopolitica.

Chi controlla l’infrastruttura open, detta le regole. Meta l’ha compreso molto prima rispetto agli altri: i modelli possono mutare, ma le API mentali degli sviluppatori sono dure a estirpare. Se abitui un’intera generazione a pensare in PyTorch, a ragionare in LLaMA, a ottimizzare con DINOv2, il futuro default dell’intelligenza artificiale parlerà un dialetto Meta, anche se il logo in alto a sinistra sarà differente.

In un’epoca in cui l’open source è diventato un concetto estetico — utile al marketing quanto lo è la sostenibilità per le multinazionali — Meta sembra voler ricostruire un’ideologia più simile a quella degli hacker dei primi anni duemila. Non per amore del collettivo, ma per potenza di posizione. L’apertura è un cavallo di Troia. Dentro ci trovi un ecosistema completo che, una volta installato, è difficile da rimuovere.

Certo, c’è anche l’ironia storica: Meta, la medesima entità che ha tracciato ogni millisecondo della tua vita sociale, ora si propone come baluardo della trasparenza AI. Ma se sei uno sviluppatore o un ricercatore con GPU a credito limitato, sai che senza quei repository pubblici, il tuo paper non esisterebbe. La tua startup non avrebbe nulla da “fine-tunare”.

La verità, come sempre, è più cinica della retorica: OpenAI ha fatto della chiusura un prodotto, mentre Meta ha trasformato l’apertura in una piattaforma. Quando LeCun afferma che “senza Meta non esisterebbe molta AI moderna”, non sta cercando attenzione. Sta semplicemente analizzando l’inventario.

Ora che l’infrastruttura rappresenta influenza e l’open source è soft power, il gioco non si gioca più solo su chi avrà il miglior modello, ma su chi definirà le regole implicite della creatività computazionale.

Là fuori ci sono miliardi in gioco, e chi controlla gli strumenti controlla le regole del gioco. E no, non è sempre chi ha più hype su Substack.

Una curiosità finale: mentre LLaMA 3 si prepara a diventare la base per ogni clone GPT-like nei prossimi sei mesi, il nome “Meta” svanisce dalle presentazioni, come un ghostwriter dimenticato. Ma ogni riga di codice, ogni token generato, ogni paper pubblicato con “basato su RoBERTa” nel metodo è una nota a piè di pagina scritta con inchiostro Meta.

La prossima volta che qualcuno ti dice “ho usato un modello open”, chiedigli chi ha scritto la libreria. Se non sa cosa sia FAIR, non sa neppure da dove origina la sua intelligenza.